Optimisation des performances Spring Boot 3.x : Stratégies JVM et ORM

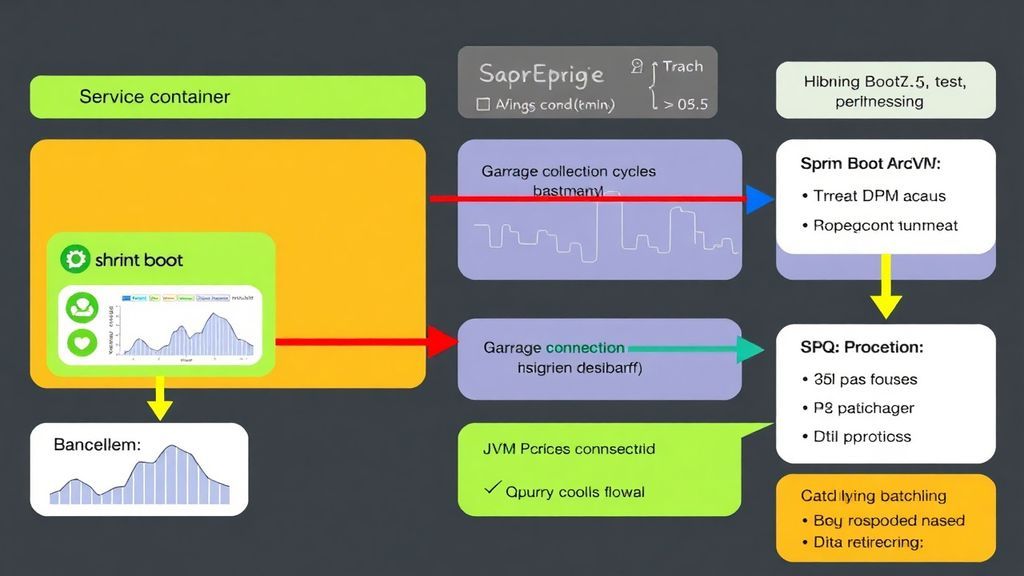

Les applications Spring Boot 3.x reposent sur un socle JVM moderne et un écosystème ORM (principalement Hibernate via Spring Data JPA). Pour améliorer la latence, la stabilité et la capacité sous charge, l’optimisation doit combiner des réglages JVM pertinents, une conception d’accès aux données efficace, et une instrumentation cohérente.

1. Fondations : mesurer avant d’ajuster

L’optimisation performante commence par l’observabilité. Les métriques et traces aident à distinguer les goulots d’étranglement CPU, mémoire, I/O et base de données.

Indicateurs typiques

- Latence (p50/p95/p99) et taux d’erreurs

- Temps SQL (exécution + attente)

- GC (fréquence, pauses, allocation rate)

- Threads (pool, saturation, contention)

Exemple d’approche de journalisation/metrics côté applicatif :

# Exemple : activer des métriques et examiner les tags

management.endpoints.web.exposure.include=health,info,metrics,prometheus

management.metrics.distribution.percentiles-histogram.http.server.requests=true

2. Stratégies JVM : réglages clés pour Spring Boot 3.x

Spring Boot 3.x s’appuie sur Java 17+ (recommandé). La JVM moderne offre déjà de nombreuses optimisations par défaut. Néanmoins, l’ajustement du garbage collector, des tailles de mémoire et des paramètres de compilation peut améliorer les performances et réduire les pauses.

2.1 Choix du Garbage Collector

Le GC influence directement la latence. Dans de nombreux cas, un GC concurrent (ex. G1GC) peut être un bon compromis. Pour des workloads spécifiques, d’autres collecteurs peuvent être considérés, mais l’évaluation doit rester guidée par les métriques de production.

Exemple de configuration JVM (indicative) pour G1GC :

# -XX:UseG1GC est souvent le défaut, mais peut être explicité

-XX:+UseG1GC

# Objectif : limiter les pauses et rendre l’allocation plus prévisible

-XX:MaxGCPauseMillis=200

# Ajustement du heap (doit être basé sur le profil de charge)

-Xms2g

-Xmx2g

2.2 Dimensionnement du heap et des métas

Un heap trop petit augmente la pression GC ; un heap trop grand peut dégrader la reprise après événements et rallonger certaines phases. Le dimensionnement doit être cohérent avec :

- le volume d’objets (allocations) pendant le traitement web

- la taille des caches applicatifs

- le comportement ORM (entités gérées, collections, first-level cache)

Les métriques GC (allocation rate, pause time, live data) guident l’ajustement.

2.3 Anti-pessimisme sur l’overhead de profiling

Les outils (profilers, APM, bytecode instrumentation) peuvent introduire un surcoût. Pour les environnements de haute criticité, une stratégie de déploiement graduelle et de sampling contrôlé est préférable.

2.4 Paramètres de thread pools : éviter la saturation

La saturation du pool de requêtes web, des pools async ou des pools de connexion peut amplifier les latences. Pour Spring, les thread pools doivent correspondre aux capacités CPU et à la nature des opérations (I/O vs CPU-bound).

Exemple d’ajustement de base (Tomcat) :

server.tomcat.threads.max=200

server.tomcat.threads.min-spare=20

server.tomcat.accept-count=100

3. Stratégies ORM : Hibernate efficace pour limiter la charge

Les performances ORM se dégradent souvent à cause des patterns de requêtes (N+1), d’une mauvaise stratégie de fetch (lazy/eager), d’un manque d’index ou d’un volume de données non maîtrisé. Les optimisations ORM se traduisent directement sur la base de données et la latence applicative.

3.1 Éviter le problème N+1

Le N+1 survient lorsqu’une collection est chargée en boucle, générant une avalanche de requêtes. La correction passe généralement par :

- des fetch joins (JPQL) ou des entity graphs

- une limitation stricte de l’accès aux propriétés relationnelles

- le passage à des requêtes de projection (DTO) si l’objectif n’est pas de gérer l’entité complète

Exemple avec fetch join (JPQL) :

@Query("""

select o

from Order o

join fetch o.customer c

where o.status = :status

""")

List<Order> findOrdersWithCustomer(@Param("status") String status);

3.2 Préférer les projections DTO aux entités complètes

Lorsqu’une API nécessite uniquement quelques champs, les projections réduisent :

- la quantité de données transférées

- le coût de construction des entités

- la charge du persistence context

Exemple de projection via JPQL :

@Query("""

select new com.acme.dto.OrderSummary(o.id, o.total, o.createdAt)

from Order o

where o.createdAt > :since

""")

List<OrderSummary> findSummaries(@Param("since") Instant since);

3.3 Gérer le persistence context (1er niveau cache)

Hibernate maintient un cache de premier niveau par transaction. Sur de gros volumes, cela peut entraîner une croissance mémoire et une dégradation des temps de flush/dirty checking. Les solutions typiques :

- limiter la taille des lots (batching)

- segmenter les transactions

- utiliser clear et flush lors des traitements batch

- réduire la traçabilité des entités modifiées quand ce n’est pas nécessaire

Exemple de boucle batch (schéma) :

for (int i = 0; i < items.size(); i++) {

// traitement + mise à jour

if (i % 50 == 0) {

entityManager.flush();

entityManager.clear();

}

}

3.4 Désactiver le comportement coûteux : N+1 et auto-flush non maîtrisé

Dans certains scénarios, l’auto-flush peut provoquer des requêtes inattendues. Une stratégie transactionnelle claire et une configuration explicite peuvent limiter ces effets.

3.5 Stratégie de cache : choisir où et quand

Les caches peuvent fortement améliorer les performances, mais doivent être utilisés avec prudence :

- Cache de 2e niveau (Hibernate) : bénéfique pour des lectures répétées, mais coûteux à invalider

- Caches applicatifs (Caffeine, Redis) : efficaces pour des résultats stables et contrôlés

- Cache HTTP (quand applicable) : réduction du trafic et de la charge back-end

Une règle pratique : d’abord optimiser les requêtes et le fetch plan, puis ajouter un cache ciblé sur des points chauds mesurés.

3.6 Configuration Hibernate utile

Les options dépendent des besoins (debug, performance, génération de requêtes). Exemple de paramètres souvent utilisés dans des environnements de production :

spring.jpa.properties.hibernate.jdbc.batch_size=50

spring.jpa.properties.hibernate.order_inserts=true

spring.jpa.properties.hibernate.order_updates=true

spring.jpa.properties.hibernate.generate_statistics=false

Ces réglages peuvent réduire le nombre d’allers-retours SQL et améliorer l’efficacité du pipeline d’écriture.

4. Connexions base de données : éviter la contention

Au-delà des requêtes, les performances dépendent fortement de la gestion des connexions : pool size, timeouts et taille des batches.

4.1 Taille du pool et limites

Un pool trop petit entraîne des délais d’attente. Un pool trop grand peut saturer la base de données.

Exemple (HikariCP) :

spring.datasource.hikari.maximum-pool-size=20

spring.datasource.hikari.minimum-idle=5

spring.datasource.hikari.connection-timeout=30000

5. Réduction des coûts : API, sérialisation et payloads

Pour une application Spring Boot 3.x, la performance ne se limite pas à JVM et ORM. Des optimisations côté API (payloads plus petits, sérialisation efficace, pagination) réduisent la pression sur le réseau et la mémoire.

Pagination et limitation des résultats

Les endpoints doivent éviter de renvoyer des collections non bornées. Les patterns recommandés :

- pagination côté base (limit/offset ou keyset pagination)

- DTOs légers

- filtrage et tri indexés

6. Plan d’action recommandé

- Instrumenter (métriques, traces, profiling ciblé)

- Identifier les hotspots (GC vs DB vs CPU)

- Corriger les requêtes ORM (fetch strategy, N+1, projections)

- Ajuster le pool de connexions et les tailles de batch

- Dimensionner heap et GC avec des preuves de production

- Valider via tests de charge et comparaisons p95/p99

Conclusion

L’optimisation des performances sur Spring Boot 3.x exige une approche combinée. La JVM fournit une base robuste pour réduire la latence (GC, heap, threads), tandis que l’ORM (Hibernate) impose une rigueur sur le modèle de requêtes (N+1, fetch plan, projections, gestion du persistence context). Les gains durables proviennent d’une démarche guidée par la mesure, puis d’ajustements validés par la charge réelle.

À propos de l'auteur

Laty Gueye Samba est développeur Full Stack basé à Dakar, Sénégal. Spécialiste des écosystèmes Java / Spring Boot et Angular.

Contact : latygueyesamba@gmail.com | Dakar, Sénégal