Optimisation des performances PostgreSQL pour les applications d’entreprise Spring Boot

Les performances d’une application d’entreprise reposent rarement sur un seul facteur. Dans une architecture Spring Boot couplée à PostgreSQL, l’optimisation passe par une combinaison de bonnes pratiques SQL, d’ajustements de configuration, d’indexation ciblée et d’observabilité robuste.

1) Mettre en place une base de diagnostic fiable

Avant toute modification, l’analyse doit être fondée sur des mesures. PostgreSQL propose plusieurs outils clés : EXPLAIN (ANALYZE, BUFFERS), pg_stat_statements, ainsi que des vues système pour suivre la charge.

Analyser un plan d’exécution

Exemple de démarche pour détecter les goulots d’étranglement (scan séquentiel, jointures coûteuses, manque d’index) :

EXPLAIN (ANALYZE, BUFFERS, VERBOSE)

SELECT

o.id, o.total

FROM orders o

WHERE o.customer_id = 12345

AND o.status = 'PAID'

ORDER BY o.created_at DESC

LIMIT 50;L’interprétation doit se concentrer sur : rows estimées vs réelles, nombre de buffers lus, et opérateurs dominants.

Activer et exploiter pg_stat_statements

pg_stat_statements permet d’identifier les requêtes les plus coûteuses en cumul (temps, nombre d’appels, plans utilisés). Cela aide à prioriser les optimisations.

-- À exécuter selon le mode d’exploitation

-- (paramètre dans postgresql.conf puis redémarrage si nécessaire)

-- shared_preload_libraries = 'pg_stat_statements'

-- pg_stat_statements.track = allUne fois activé, l’extraction typique se fait via :

SELECT

calls,

mean_exec_time,

rows,

query

FROM pg_stat_statements

ORDER BY mean_exec_time DESC

LIMIT 20;2) Indexation : viser la sélectivité et les patterns de requêtes

L’indexation est la première arme, mais une stratégie aveugle peut dégrader les écritures et alourdir le planificateur. Une indexation efficace s’appuie sur les patterns de filtrage, tri et jointures.

Créer des index composites adaptés

Pour des conditions combinant plusieurs colonnes, un index composite peut améliorer significativement les performances.

CREATE INDEX CONCURRENTLY idx_orders_customer_status_created

ON orders (customer_id, status, created_at DESC);Les bénéfices attendus se manifestent souvent avec : WHERE (prédicats), ORDER BY et LIMIT.

Éviter les index inutiles

Les index doivent être validés par EXPLAIN. Un index non utilisé n’améliore pas les performances et augmente le coût des opérations INSERT, UPDATE et DELETE.

-- Contrôle de l’utilisation (selon permissions et contexte)

SELECT

schemaname, relname, indexrelname,

idx_scan

FROM pg_stat_user_indexes

ORDER BY idx_scan ASC

LIMIT 20;3) Ajuster le configurateur PostgreSQL pour la charge applicative

Les paramètres PostgreSQL influencent directement le cache, la concurrence, le traitement des requêtes et l’I/O. Les réglages doivent correspondre à la taille mémoire, au type de charge (lecture/écriture) et au dimensionnement de la machine.

Règles générales utiles

Les paramètres ci-dessous sont fréquemment déterminants :

- shared_buffers : mémoire dédiée au cache de données.

- effective_cache_size : estimation de la mémoire disponible pour le cache (faisceaux au planificateur).

- work_mem : mémoire pour les opérations internes (tri, hash). À dimensionner avec prudence.

- maintenance_work_mem : utile pour les opérations d’administration (VACUUM, CREATE INDEX).

- autovacuum et coûts VACUUM : essentiels pour maintenir les performances.

Exemple de profilage et validation

Après modification, il est indispensable de valider via des mesures : latence, CPU, I/O, nombre de verrous, et évolution des plans.

# Exemple fictif de paramètres (à adapter strictement au contexte)

# shared_buffers = '2GB'

# effective_cache_size = '6GB'

# work_mem = '64MB'

# autovacuum = on4) Gérer la concurrence et les verrous côté requêtes

Les performances peuvent se dégrader fortement à cause de la contention (verrous, transactions longues, mauvaise isolation). En environnement Spring Boot, il est fréquent d’observer des goulots liés à : transactions trop longues, opérations batch mal dimensionnées et verrouillage involontaire.

Détecter les verrous

Le diagnostic peut s’appuyer sur :

SELECT

a.pid, a.query,

l.mode, l.granted,

n.nspname, c.relname

FROM pg_stat_activity a

JOIN pg_locks l ON l.pid = a.pid

LEFT JOIN pg_class c ON c.oid = l.relation

LEFT JOIN pg_namespace n ON n.oid = c.relnamespace

WHERE a.datname = current_database();5) Qualité SQL : requêtes stables, jointures efficaces, planification cohérente

Une optimisation performante combine des requêtes mieux structurées et une exécution plus prédictible. Les aspects clés incluent :

- Limiter les colonnes retournées (éviter le sur-fetch).

- Éviter les fonctions sur les colonnes filtrées lorsque cela empêche l’usage d’index.

- Réévaluer les jointures (EXISTS vs IN vs JOIN selon le contexte).

- Contrôler la cardinalité (statistiques à jour).

Statistiques et ANALYZE

Des statistiques obsolètes peuvent mener le planificateur vers des choix incorrects. La maintenance via VACUUM/ANALYZE doit être surveillée, surtout sur des tables à forte volatilité.

ANALYZE orders;6) Spring Boot : aligner le pooling, la pagination et la stratégie transactionnelle

La performance “end-to-end” dépend aussi des paramètres Hibernate/JPA et du comportement du pool de connexions. Une approche cohérente réduit les temps d’attente et évite de multiplier les requêtes coûteuses.

Configurer un pool de connexions adapté

En général, un pool comme HikariCP doit être dimensionné pour le niveau de concurrence réel. Un pool trop petit provoque des attentes ; trop grand augmente la charge sur PostgreSQL.

# Exemple indicatif (application.properties)

spring.datasource.hikari.maximum-pool-size=20

spring.datasource.hikari.minimum-idle=5Pagination : éviter les scans “non bornés”

La pagination doit être conçue avec soin. Les requêtes de type OFFSET/LIMIT sur de très grands jeux de données peuvent devenir coûteuses. Une alternative consiste à utiliser une pagination par curseur (selon schéma et index).

-- Pagination par curseur (exemple)

SELECT id, total

FROM orders

WHERE customer_id = ?

AND status = ?

AND created_at < ?

ORDER BY created_at DESC

LIMIT 50;Optimiser le modèle JPA/Hibernate

Les relations et la stratégie de chargement (lazy/eager) influencent directement le nombre de requêtes. Une approche “N+1” peut dégrader les performances de manière drastique.

Les bonnes pratiques incluent : fetch joins quand approprié, définition claire des DTO, et limitation des cascades coûteuses.

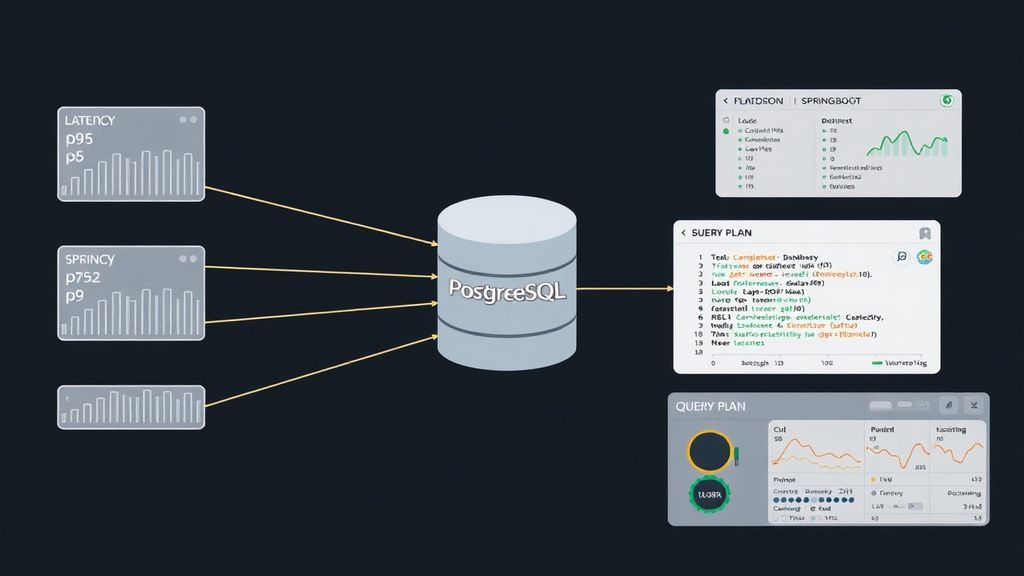

7) Observabilité : corréler latence applicative et métriques PostgreSQL

Un système performant doit être observé en continu. L’association d’informations côté base et côté application permet de relier : latence HTTP (ou temps de traitement), temps SQL et ressources PostgreSQL.

Mesures à suivre

- Temps moyen/percentiles des requêtes (p95/p99), via logs ou APM.

- Nombre de verrous et transactions actives.

- Fréquence VACUUM/ANALYZE, croissance des tables, bloat.

- Utilisation CPU, lecture/écriture disque, hit ratio cache (si disponible).

8) Plan d’action recommandé (checklist)

Pour une démarche pragmatique, la priorisation suit généralement cet ordre :

- Identifier les requêtes lentes et fréquentes (pg_stat_statements, logs applicatifs).

- Valider les plans avec EXPLAIN (ANALYZE, BUFFERS).

- Corriger les index manquants ou mal orientés (composites, ordre, covering si pertinent).

- Maintenir les statistiques et la propreté via VACUUM/ANALYZE.

- Réajuster les paramètres PostgreSQL (mémoire, work_mem, cache estimations).

- Aligner les paramètres Spring Boot/JPA (pool, pagination, stratégie de chargement).

- Mesurer à nouveau et documenter les gains.

Conclusion

L’optimisation PostgreSQL pour Spring Boot est un exercice d’ingénierie orienté données. Une approche structurée—diagnostic, indexation ciblée, maintenance, réglages contrôlés et corrélation applicative—permet d’obtenir des gains durables en latence et en robustesse.

Pour maximiser l’impact, chaque changement doit être validé par des mesures (plans d’exécution et métriques de production), avec une attention particulière aux effets secondaires sur la concurrence, les écritures et la maintenance.

À propos de l'auteur

Laty Gueye Samba est développeur Full Stack basé à Dakar, Sénégal. Spécialiste des écosystèmes Java / Spring Boot et Angular.

Contact : latygueyesamba@gmail.com | Dakar, Sénégal